Muchos equipos en el lugar de trabajo ahora usan ChatGPT, ya que les permite completar proyectos de escritura rápidamente, considerar problemas complejos y manejar fácilmente las tareas que deben repetirse. Ahora usamos IA regularmente para escribir correos electrónicos, tomar notas de reuniones y generar nuevas concepts.

Sin embargo, al igual que cualquier otra herramienta fuerte, nuestro enfoque es importante. Si no ponemos las salvaguardas necesarias, podemos dar datos privados, usar IA sin verificar o usar tecnologías de IA contra políticas o ética de la empresa. Como resultado, cada organización debe asegurarse de que sus equipos estén utilizando CHATGPT de manera responsable.

Explicaremos en este artículo por qué el uso responsable es tan esencial, qué principios debe seguir, qué programa de capacitación es necesario, cómo establecer las pautas establecidas y los recursos principales para apoyar al private de su aprendiz en el uso de las redes sociales de manera segura.

¿Por qué importa el uso correcto de ChatGPT?

Conocer las limitaciones de ChatGPT es esencial antes de comenzar a usarlo.

Se ocupa del tema de proteger mucho los datos personales. Si comunica información confidencial en ChatGPT, podría terminar dejando a la empresa por accidente.

Y, por último, hay alucinación, cuando la IA crea información que cree que es verdad, pero resulta ser falso. Apresurarse en el proceso puede llevarlo a confiar en los datos incorrectos.

Otro problema es el sesgo. ChatGPT ha sido capacitado utilizando muchos datos de Web, por lo que puede mostrar o mejorar cualquier sesgo en la información. Después de usar la herramienta por un tiempo, las personas pueden comenzar a depender de ello tanto que se salten el pensamiento y el juicio críticos.

Estas preocupaciones también implican cuestiones de regulaciones y ética. Los errores sobre su privacidad, coprotagonista o cualquier requisito en línea relacionado pueden tener problemas de imagen authorized y pública para la empresa.

Si la IA se usa de manera irresponsable, puede romper la confianza, dar lugar a problemas generales e invitar a errores caros. Por lo tanto, debemos asegurarnos de que los equipos estén informados y guiados sobre cómo usar CHATGPT de manera segura y adecuada.

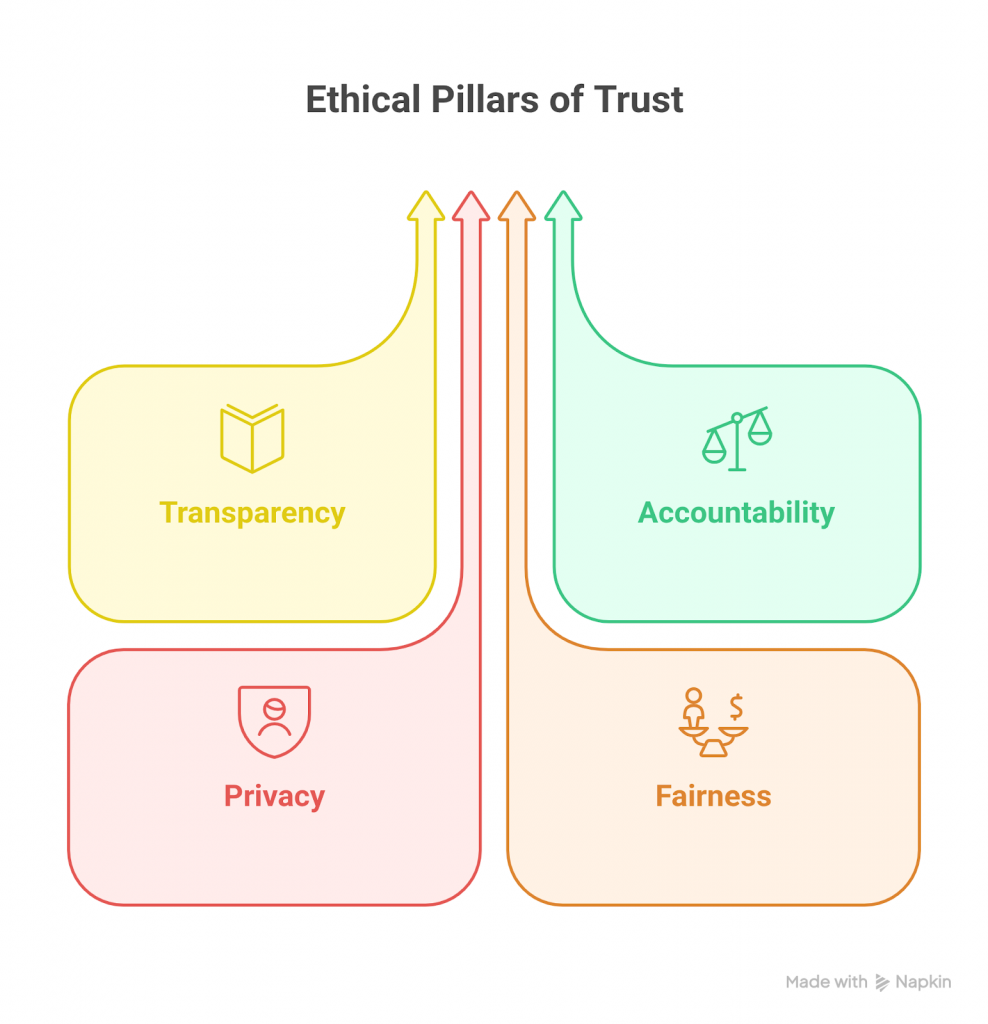

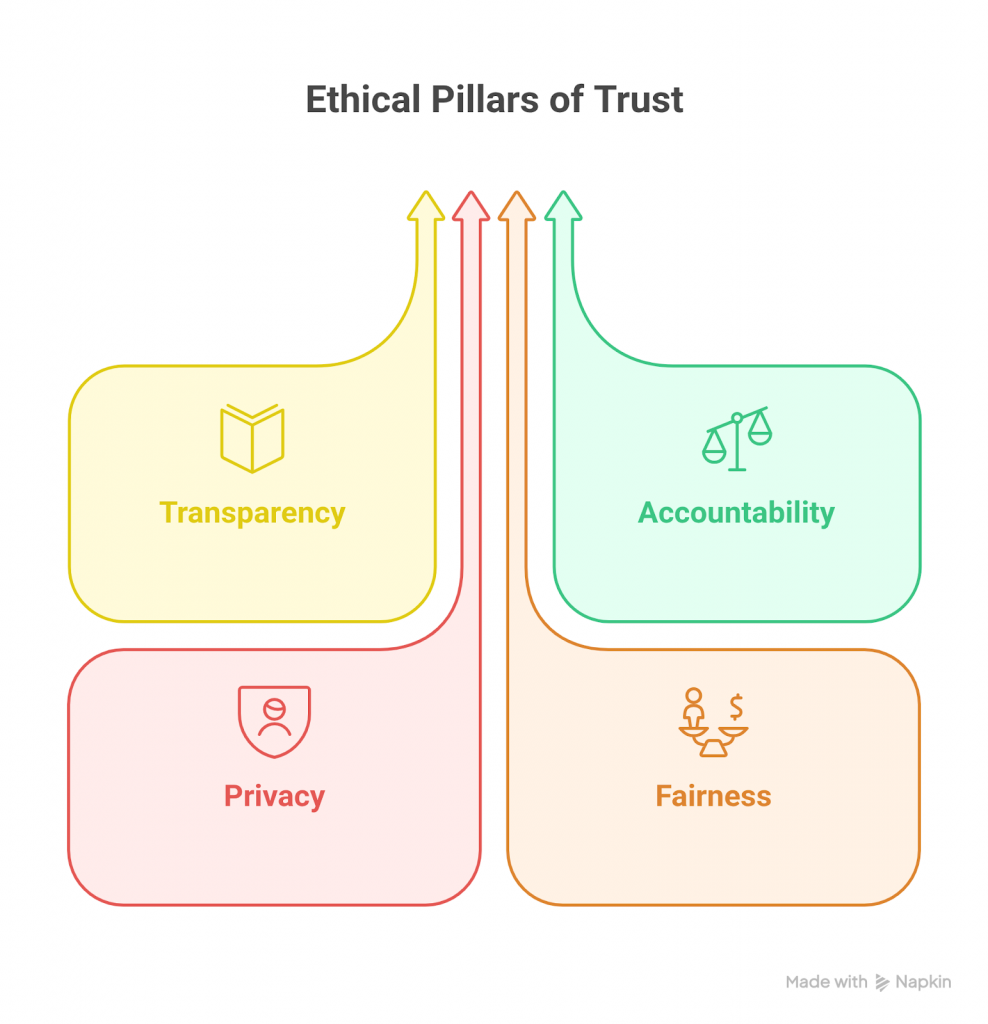

Principios clave del uso de IA responsable

Usar chatgpt de manera inteligente significa ser responsable y consciente de sus habilidades. Comienza con algunas concepts principales.

Primero es transparencia. Si está utilizando AI para ayudar a crear contenido, ya sea un correo electrónico del cliente, un informe o incluso mensajes internos, es esencial ser sincero al respecto. Las personas merecen saber cuándo interactúan con algo generado o asistido por una máquina.

Entonces viene responsabilidad. ChatGPT puede ser útil, pero no debe reemplazar el juicio humano. Cualquier cosa que produzca la herramienta debe revisarse, verificar los hechos y, en última instancia, aprobarse por alguien que comprenda el contexto y las consecuencias del contenido.

Privacidad y seguridad de datos tampoco son no negociables. Los equipos deben evitar poner información confidencial en indicaciones, como datos de clientes, planes internos o archivos confidenciales. Incluso si parece inofensivo, una vez que esos datos están disponibles, no siempre puede controlar a dónde va.

Finalmente, guarda justicia y parcialidad en mente. El modelo a veces puede reflejar sesgos ocultos de los datos en los que fue entrenado. Eso significa ser reflexivo sobre el tono, el lenguaje y las suposiciones, y estar dispuesto a retrasar o reelaborar los resultados cuando algo no se siente bien.

Estos principios establecen las bases para un uso seguro, respetuoso e innovador.

Important de entrenamiento para equipos

Comprender la herramienta

Antes de usar ChatGPT, las personas deben conocer sus fortalezas y debilidades. ChatGPT puede escribir textos, acortar documentos, producir concepts y apoyar el proceso de pensamiento.

Sin embargo, no tiene el mismo entendimiento que las personas, y a veces puede estar mal. No puede entender lo que está sucediendo en este momento y no siempre es consciente de que ha cometido un error.

La práctica debe centrarse en el punto de que ChatGPT es una herramienta para escribir, no una fuente de respuestas o alguien que pueda tomar decisiones cruciales. El juicio humano debe usarse además de las máquinas, en lugar de reemplazarlo.

Al ayudar a los equipos a comprender qué puede y no puede hacer ChatGPT, es útil ofrecer un aprendizaje estructurado. Por ejemploeste curso gratuito en chatgpt para comunicación empresarial Ofrece a los profesionales una base clara sobre el uso de la herramienta de manera efectiva en escenarios de trabajo cotidianos.

Promover el pensamiento crítico

Debemos recordar no aceptar los resultados dados por AI simplemente. Hacer una declaración audaz no garantiza que sea cierto. Involucre a los equipos a tomarse su tiempo y leer las instrucciones.

¿El contenido tiene sentido? ¿Son correctos los hechos? ¿Es apropiado el tono? La verificación es importante, especialmente cuando se utilizan contenido generado por IA en comunicaciones del cliente, materiales públicos o cualquier cosa que conlleva riesgos.

Trate las respuestas de ChatGPT como borradores o puntos de partida, no respuestas finales. Los equipos deben sentirse cómodos desafiando los resultados, editarlos o descartarlos si no cumplen con la marca.

Prácticas de entrada seguras

La buena salida comienza con una entrada segura. Los equipos nunca deben ingresar información privada, private o confidencial en ChatGPT. Eso incluye nombres de clientes, datos de empleados, detalles financieros, contraseñas o documentos internos.

Una buena regla common: si no se lo envía por correo electrónico a alguien fuera de su organización, no lo pegue en ChatGPT. Use datos anónimos o generales al experimentar o solicitar.

También es inteligente recordar a los equipos que, si bien ChatGPT puede simular la conversación humana, sigue siendo una máquina y no debe tratarse como un espacio de trabajo seguro y privado.

Directrices de uso de casos

Los límites claros contribuyen en gran medida a generar confianza. Los equipos deben saber qué chatgpt poder ser utilizado para y dónde está la línea. Los casos de uso aprobados incluyen escribir esquemas, redacción de correos electrónicos básicos o resumir información no wise.

Los usos prohibidos podrían incluir la generación de asesoramiento authorized, reemplazar las comunicaciones reguladas o el manejo de datos confidenciales del cliente. Hacer una lista básica de hábitos buenos y malos puede garantizar que todos comprendan cómo usar la herramienta de manera segura.

Asegúrese de que las pautas estén disponibles para todo el private y que las actualice cuando las necesidades de su empresa cambien.

Desarrollo de pautas y políticas internas

Las organizaciones necesitan más que buenas intenciones para usar ChatGPT de manera responsable a escala. Necesitan pautas claras y prácticas que todos puedan seguir.

- Comience por desarrollar reglas contextuales que reflejen su industria, sensibilidad a los datos y flujos de trabajo internos.

Por ejemplo, un equipo de advertising and marketing podría usar ChatGPT para redactar publicaciones de weblog, mientras que un equipo authorized debe evitar usarlo para el lenguaje de contrato. Las reglas deben coincidir con los riesgos y realidades de cada departamento.

- La consistencia es clave. Sin él, los equipos pueden desarrollar sus propias prácticas informales, algunas seguras, otros no.

Un conjunto compartido de expectativas ayuda a mantener a todos en la misma página y cut back el riesgo de mal uso. Esto puede incluir las herramientas aprobadas por el nombre, la definición de casos de uso aceptables y marcar escenarios de alto riesgo.

- También ayuda a crear simples y repetibles plantillas y ejemplos. Muestre a los empleados cómo se ve un mensaje seguro. Esborativo cuando el contenido debe ser revisado por un gerente o el equipo de cumplimiento.

Por ejemplo: “Use AI para una lluvia de concepts, pero toda la copia orientada al cliente debe revisarse antes de publicar”.

- Cuando las políticas son claras y fáciles de aplicar, es más possible que se sigan. Estas barandillas internas convierten el uso responsable de la IA de un concepto en una práctica consistente y cotidiana.

Para aquellos que dan forma a las políticas internas de la IA o los marcos de capacitación, el aprendizaje más profundo ayuda. Programas como el AI y programa de aprendizaje automático de Nice Lakes Ofrezca información esencial sobre cómo funcionan estas herramientas, ayudando a los líderes a establecer estándares realistas y seguros para su uso.

Aprendizaje continuo y mejora

La tecnología no se detiene, ni el enfoque de su equipo para usar herramientas como ChatGPT. A medida que se despliegan las nuevas características o las necesidades de la compañía, es esencial seguir aprendiendo y ajustando.

Las oportunidades de aprendizaje regulares ayudan a los empleados a mantener el ritmo de los cambios de IA y mejorar sus habilidades. Cursos como Chatgpt para profesionales que trabajan son excelentes para esto: están diseñados para adaptarse a los horarios ocupados al tiempo que ofrecen aplicaciones prácticas y prácticas.

Haga espacio para registros regulares. Pregúntele a los equipos qué está funcionando, dónde tienen problemas y qué podría mejorarse. Estas concepts pueden ayudarlo a ajustar el entrenamiento, actualizar las pautas o atrapar puntos ciegos temprano.

Las verificaciones spot ocasionales sobre cómo se usa la herramienta, nada pesado, también puede ayudar a los problemas de la superficie antes de que se conviertan en problemas reales.

Igualmente valioso es alentar a los equipos a intercambiar consejos para usar Chat GPT. Un easy hilo flojo o almuerzo y aprendizaje puede recorrer un largo camino. Cuando las personas comparten cómo están usando bien el chatgpt, otros se benefician y la calidad common del trabajo mejora.

No se trata de dominar la herramienta una vez y olvidarla. Se trata de mantener abierta la conversación, mantenerse curiosidad y ayudar a todos a mejorar con el tiempo.

Dar a los equipos las herramientas adecuadas hace que el uso responsable sea mucho más fácil.

- Comenzar con módulos de entrenamiento Ese paseo por hacer y no hacer, combinado con documentación interna fácil de leer o wikis para una referencia rápida.

Si su organización utiliza herramientas de monitoreo, estos pueden ayudar a rastrear los patrones de uso y los riesgos potenciales de marcar.

- Operai y otros proveedores también ofrecen Plantillas de políticas, pautas inmediatas y recursos de seguridad Eso se puede adaptar para satisfacer sus necesidades.

Punta los equipos a estos materiales como parte de la incorporación o la capacitación common. Cuando el soporte es fácil de acceder, es mucho más possible que las personas usen la herramienta cuidadosamente y dentro de los límites seguros.

Para apoyar el aprendizaje, considere señalar a los equipos a cursos bien diseñados o opciones de calvería internas. Programas como el Curso generativo de IA puede profundizar la comprensión, especialmente para los roles que dan forma a políticas internas o flujos de trabajo alrededor de la IA.

Para aquellos que buscan acceso continuo y versatile a una mejora profesional, hemos lanzado recientemente Academy Professionalun plan de suscripción que desbloquea todos nuestros cursos premium por solo ₹ 799/mes.

Con esto, los alumnos ya no necesitan comprar cursos individuales, lo que hace que sea más fácil y más asequible que los equipos construyan continuamente sus capacidades de IA y se mantengan actualizados con las últimas prácticas de uso responsables

Conclusión

ChatGPT y herramientas similares se están convirtiendo en parte del package de herramientas cotidiano en el trabajo. Pero como cualquier herramienta, la forma en que se usa marca la diferencia. Con un poco de estructura y capacitación clara, los equipos pueden usarlo bien sin arriesgar datos, reputación o confianza confidenciales.

Los líderes tienen un papel importante en hacer que eso suceda. Invertir en capacitación y establecer algunas pautas simples y prácticas ayuda a todos a mantenerse en la misma página.

Si aún no lo ha hecho, ahora es un buen momento para revisar o crear políticas internas. Algunos pasos reflexivos hoy pueden ahorrar muchos problemas en el futuro.